Una nueva ciberseguridad en la era de la computación cuántica

El ordenador cuántico estable y operativo está aún lejos. Pero su desarrollo revelaría códigos que blindan información estratégica.

%20(1).webp)

Índice de contenido:

En 1997, el premio Nobel de Física William Daniel Phillips definía el paso de la computación tradicional, la que aún usamos, a la computación cuántica como un salto equivalente al de un ábaco a un ordenador.

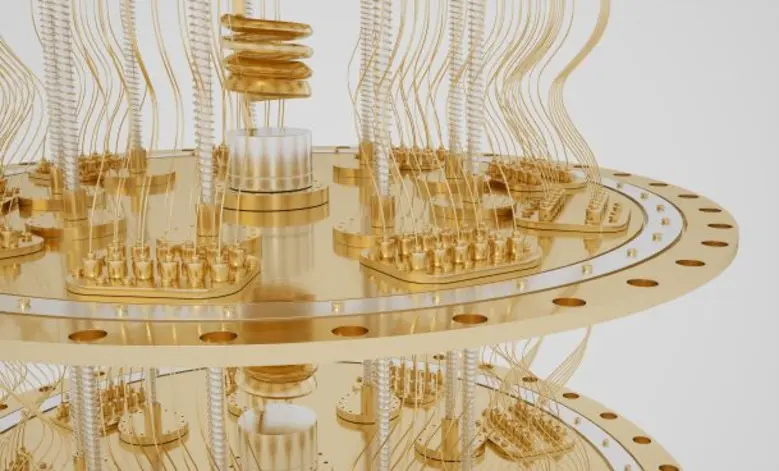

Quizá se podría matizar una afirmación tan tajante, pero no parece exagerada en cuanto a la capacidad de cálculo. A finales de 2019, Google presentaba un procesador cuántico de 53 cúbits (la unidad básica de procesamiento, como el bit convencional) supuestamente capaz de resolver en algo más de tres minutos una operación a la que el superordenador más potente del mundo tendría que dedicar 10.000 años. En 2021, los chinos aseguran que su procesador Jiuzhang 2.0 puede calcular en un milisegundo lo que ese superordenador tardaría 30 billones de años, es decir, nunca. En noviembre del año pasado, IBM bate el récord de cúbits en un procesador, 127, y anuncia que en 2023 tendrá listo uno con 1.121.

Se buscan nuevos protocolos

Esta competición tecnológica podría parecerse a otras como la carrera espacial, la inteligencia artificial o la nanotecnología, pero el procesamiento cuántico está en otro plano porque implica un cambio total de paradigma informático, una forma completamente nueva de procesar tanto en cantidad como en complejidad de operaciones. Por eso el físico Daniel Phillips dijo aquello del ábaco. Y por eso, la competencia cuántica entre países no solo es tecnológica sino armamentista, porque ese nuevo paradigma promete dejar obsoleto el modelo de ciberseguridad actual desarrollado para la informática tal y como la conocemos.

El procesamiento cuántico no es una panacea, no sirve para todo, pero sí es especialmente hábil en problemas matemáticos inabordables para la computación convencional, desde el comportamiento de la materia a escala atómica a los modelos meteorológicos, las prospectivas financieras o la encriptación que protege comunicaciones, claves y datos. Un ordenador cuántico con suficiente madurez podría desentrañar con facilidad la mayoría sino todos los códigos encriptados actuales. De no adaptarse, la ciberseguridad quedaría tan inerme como las viejas murallas medievales ante la artillería moderna.

Carrera de armamento

Si en ciberseguridad la clave es siempre anticipar, prevenir, en lugar de reaccionar a posteriori, con mucho más motivo ante el avance de los cúbits. Por lo tanto no se trata solo de generar un nuevo paradigma criptográfico basado en algoritmos cuánticos cuando los procesadores lo permitan, sino de desarrollar nuevos protocolos o modelos de encriptación mucho antes, para migrar los datos más sensibles y resistir a los próximos procesadores mejorados. Gobiernos como el chino, el estadounidense y también la Unión Europea están en ello. Por ejemplo el NITS (Instituto Nacional de Estándares de EE UU) desarrolla una iniciativa desde 2017 para seleccionar nuevos protocolos, por ejemplo basados en redes, de lo que se ha llamado “criptografía post-cuántica”. Tras varias fases de selección, hace pruebas con cuatro propuestas de cifrado y tres de firma segura para identificación en transacciones financieras.

Por eso diferentes instituciones, desde la NASA al Consorcio de Desarrollo Económico Cuántico, además de expertos como el informático y filósofo español Sergio Boixo —jefe de programadores que contribuyeron al procesador de Google— recomiendan a gobiernos y empresas, especialmente a las que manejan información crítica, tomarse muy en serio el asunto, introducirse en la cultura cuántica para entender la dimensión del problema y su inmediatez, y prepararse para incorporar más pronto que tarde nuevos modelos de encriptación.

El talento tecnológico será clave si el paradigma cuántico implica nuevos conocimientos y conceptos, profesiones y especialidades inéditas, nuevos procesos y dispositivos, incluso durante la larga fase donde convivirá con la informática convencional en modo híbrido. De hecho se considera que ese activo, el talento, podría ser uno de los grandes cuellos de botella del futuro cuántico. Es decir, que se produzca en cantidad y calidad suficiente.

El gran reto de la estabilidad

No obstante, esos procesadores que comentábamos al principio, a pesar de las impactantes cifras de cálculo que proclaman sus desarrolladores, aún están muy lejos de desentrañar los algoritmos de cifrado actuales. No solo necesitarán muchos más cúbits, sino solucionar o al menos reducir su gran talón de Aquiles: la enorme inestabilidad de su funcionamiento. La operatividad de los cúbits es brevísima, se influyen unos a otros adulterando el resultado del cálculo y necesitan refrigerarse a -273 grados, entre otras causas.

Pero atención, esa sensación de tener margen de tiempo es relativamente falsa. Primero porque, aunque el ordenador cuántico estable y operativo esté a décadas de distancia, la progresiva evolución de los procesadores hacia esa meta podría bastar para desencriptar información estratégica, desde secretos militares y operaciones financieras a espionaje industrial o tecnológico. Además podría aplicarse con una especie de efecto retroactivo si una organización criminal, un servicio de inteligencia o un gobierno acumulan información encriptada a la espera de tener la suficiente capacidad cuántica para desentrañarla. ¿Cuándo? Algunos expertos hablan de una década o quizá menos para que los hackers cuánticos sean capaces de agrietar el escudo de la criptografía.